Matrices : Entraînement Terminale Maths Expertes

Révisions et exercices d'entraînement sur les matrices pour la Terminale Expertes pour aller plus loin.

À Savoir : Rappels de Cours et Exemples Développés pour Maîtriser les Matrices.

1. Définition et Opérations de Base

Bonjour à tous ! Commençons par le début : qu'est-ce qu'une matrice ? Imaginez un tableau bien organisé de nombres. En Terminale, on se concentre surtout sur les matrices carrées, c'est-à-dire celles qui ont autant de lignes que de colonnes, et avec des nombres réels à l'intérieur. C'est notre outil principal pour manipuler des systèmes linéaires et bien plus !

Les opérations de base, c'est comme avec les nombres, mais adaptées aux matrices :

- Addition et Soustraction : Très simple ! On additionne (ou soustrait) les éléments qui se trouvent à la même position dans les matrices. Attention : On ne peut le faire que si les matrices ont exactement la même taille (même nombre de lignes et de colonnes). C'est comme comparer des pommes avec des pommes !

Exemple simple : Soient \(A = \begin{pmatrix} 1 & 2 \\ 3 & 4 \end{pmatrix}\) et \(B = \begin{pmatrix} 5 & -1 \\ 0 & 2 \end{pmatrix}\). Alors, $$A + B = \begin{pmatrix} 1+5 & 2+(-1) \\ 3+0 & 4+2 \end{pmatrix} = \begin{pmatrix} 6 & 1 \\ 3 & 6 \end{pmatrix}$$

- Multiplication par un scalaire : Un scalaire, c'est juste un nombre réel (comme 2, -3, 0.5...). Multiplier une matrice par un scalaire, c'est multiplier chaque élément de la matrice par ce nombre. C'est comme agrandir ou rétrécir toute la matrice uniformément.

Exemple : Si \(A = \begin{pmatrix} 1 & 2 \\ 3 & 4 \end{pmatrix}\) et \(\lambda = 3\), alors $$\lambda A = 3 \begin{pmatrix} 1 & 2 \\ 3 & 4 \end{pmatrix} = \begin{pmatrix} 3\times1 & 3\times2 \\ 3\times3 & 3\times4 \end{pmatrix} = \begin{pmatrix} 3 & 6 \\ 9 & 12 \end{pmatrix}$$

- Produit matriciel : Là, ça devient un peu plus intéressant ! Pour multiplier deux matrices \(A\) et \(B\), il faut que le nombre de colonnes de \(A\) soit égal au nombre de lignes de \(B\). Le résultat \(AB\) aura autant de lignes que \(A\) et autant de colonnes que \(B\). Pour trouver l'élément à la position \((i, j)\) dans \(AB\), on prend la \(i\)-ème ligne de \(A\) et la \(j\)-ème colonne de \(B\), on multiplie les éléments correspondants et on additionne le tout. Important : En général, \(AB \neq BA\). L'ordre compte énormément dans le produit matriciel ! On dit que le produit matriciel n'est pas commutatif.

Conseil Pratique : Visualisez bien les lignes de la première matrice qui "rencontrent" les colonnes de la deuxième. C'est la clé pour ne pas se tromper dans le produit matriciel !

Exemple de Produit Matriciel :

Soient \(A = \begin{pmatrix} 1 & 2 \\ 3 & 4 \end{pmatrix}\) et \(B = \begin{pmatrix} 5 & 6 \\ 7 & 8 \end{pmatrix}\). Alors, $$AB = \begin{pmatrix} (1\times5 + 2\times7) & (1\times6 + 2\times8) \\ (3\times5 + 4\times7) & (3\times6 + 4\times8) \end{pmatrix} = \begin{pmatrix} 19 & 22 \\ 43 & 50 \end{pmatrix}$$

Et si on essayait \(BA\) ? $$BA = \begin{pmatrix} (5\times1 + 6\times3) & (5\times2 + 6\times4) \\ (7\times1 + 8\times3) & (7\times2 + 8\times4) \end{pmatrix} = \begin{pmatrix} 23 & 34 \\ 31 & 46 \end{pmatrix}$$ On voit bien que \(AB \neq BA\) !

2. Inversibilité d'une Matrice et Déterminant

Maintenant, parlons d'inversibilité. Une matrice carrée \(A\) est dite inversible si on peut trouver une autre matrice, qu'on appelle son inverse et qu'on note \(A^{-1}\), telle que lorsqu'on les multiplie (dans les deux sens !), on obtient la matrice identité \(I_n\). La matrice identité, c'est l'équivalent du nombre 1 pour les matrices : elle a des 1 sur la diagonale et des 0 partout ailleurs. Donc, on doit avoir : $$AA^{-1} = A^{-1}A = I_n$$

Mais comment savoir si une matrice est inversible et comment calculer son inverse ?

- Avec le Déterminant : Le déterminant, c'est un nombre qu'on associe à chaque matrice carrée. Pour une matrice 2x2 \(A = \begin{pmatrix} a & b \\ c & d \end{pmatrix}\), le déterminant est donné par \(\det(A) = ad - bc\). Et la règle d'or : une matrice carrée \(A\) est inversible si et seulement si son déterminant \(\det(A)\) est différent de zéro. C'est un test très rapide pour savoir si on peut inverser une matrice !

Exemple : \(A = \begin{pmatrix} 2 & 3 \\ 4 & 5 \end{pmatrix}\), \(\det(A) = (2\times5) - (3\times4) = 10 - 12 = -2\). Comme \(\det(A) = -2 \neq 0\), la matrice \(A\) est inversible.

- Règle de Sarrus (pour les matrices 3x3) : Pour les matrices 3x3, on a une méthode pratique pour calculer le déterminant : la règle de Sarrus. Soit une matrice \(A = \begin{pmatrix} a & b & c \\ d & e & f \\ g & h & i \end{pmatrix}\). On recopie les deux premières colonnes à droite de la matrice : $$\begin{pmatrix} a & b & c & a & b \\ d & e & f & d & e \\ g & h & i & g & h \end{pmatrix}$$ Puis, on calcule la somme des produits des diagonales descendantes et on soustrait la somme des produits des diagonales montantes :

$$\det(A) = (aei + bfg + cdh) - (ceg + afh + bdi)$$

Exemple avec Sarrus : Calculons le déterminant de \(M = \begin{pmatrix} 1 & 2 & 3 \\ 4 & 5 & 6 \\ 7 & 8 & 9 \end{pmatrix}\). $$\det(M) = (1\times5\times9 + 2\times6\times7 + 3\times4\times8) - (3\times5\times7 + 1\times6\times8 + 2\times4\times9)$$ $$\det(M) = (45 + 84 + 96) - (105 + 48 + 72) = 225 - 225 = 0$$ Comme le déterminant est 0, la matrice \(M\) n'est pas inversible.

Conseil Pratique : La règle de Sarrus est super pour les matrices 3x3, mais elle ne fonctionne pas pour les matrices plus grandes ! Pour les matrices plus grandes, il faut utiliser d'autres méthodes comme le développement par cofacteurs ou la méthode du pivot de Gauss.

- Méthode des cofacteurs (ou développement par mineurs) : Cette méthode est plus générale que la règle de Sarrus et fonctionne pour les matrices carrées de toute taille. Elle repose sur le développement du déterminant en utilisant les cofacteurs.

Mineur et Cofacteur :

-

Le mineur d'un élément \(a_{ij}\) d'une matrice \(A\), noté \(M_{ij}\), est le déterminant de la sous-matrice obtenue en supprimant la \(i\)-ème ligne et la \(j\)-ème colonne de \(A\).

Le cofacteur d'un élément \(a_{ij}\), noté \(C_{ij}\), est le mineur multiplié par un signe qui dépend de la position de l'élément : \(C_{ij} = (-1)^{i+j} M_{ij}\). Le signe \( (-1)^{i+j} \) suit un motif en damier :

$$\begin{pmatrix} + & - & + & - & \cdots \\ - & + & - & + & \cdots \\ + & - & + & - & \cdots \\ - & + & - & + & \cdots \\ \vdots & \vdots & \vdots & \vdots & \ddots \end{pmatrix}$$

Développement par cofacteurs : Le déterminant d'une matrice \(A\) peut être calculé en choisissant une ligne ou une colonne, puis en sommant les produits des éléments de cette ligne (ou colonne) par leurs cofacteurs correspondants.

Développement par rapport à la \(i\)-ème ligne : $$\det(A) = \sum_{j=1}^{n} a_{ij} C_{ij} = a_{i1}C_{i1} + a_{i2}C_{i2} + \cdots + a_{in}C_{in}$$

Développement par rapport à la \(j\)-ème colonne : $$\det(A) = \sum_{i=1}^{n} a_{ij} C_{ij} = a_{1j}C_{1j} + a_{2j}C_{2j} + \cdots + a_{nj}C_{nj}$$

Exemple avec les cofacteurs : Calculons le déterminant de \(M = \begin{pmatrix} 1 & 2 & 3 \\ 4 & 5 & 6 \\ 7 & 8 & 9 \end{pmatrix}\) en utilisant le développement par cofacteurs le long de la première ligne (i=1).

-

Pour \(a_{11} = 1\): \(M_{11} = \det \begin{pmatrix} 5 & 6 \\ 8 & 9 \end{pmatrix} = (5 \times 9) - (6 \times 8) = 45 - 48 = -3\). \(C_{11} = (-1)^{1+1} M_{11} = 1 \times (-3) = -3\).

Pour \(a_{12} = 2\): \(M_{12} = \det \begin{pmatrix} 4 & 6 \\ 7 & 9 \end{pmatrix} = (4 \times 9) - (6 \times 7) = 36 - 42 = -6\). \(C_{12} = (-1)^{1+2} M_{12} = -1 \times (-6) = 6\).

Pour \(a_{13} = 3\): \(M_{13} = \det \begin{pmatrix} 4 & 5 \\ 7 & 8 \end{pmatrix} = (4 \times 8) - (5 \times 7) = 32 - 35 = -3\). \(C_{13} = (-1)^{1+3} M_{13} = 1 \times (-3) = -3\).

Donc, \(\det(M) = a_{11}C_{11} + a_{12}C_{12} + a_{13}C_{13} = (1 \times -3) + (2 \times 6) + (3 \times -3) = -3 + 12 - 9 = 0\).

Conseils Pratiques :

-

La méthode des cofacteurs fonctionne pour les matrices de toute taille, contrairement à la règle de Sarrus qui est limitée aux matrices 3x3.

Pour les matrices de grande taille, le développement par cofacteurs peut devenir rapidement calculatoirement intensif. Il est souvent plus efficace de choisir la ligne ou la colonne avec le plus de zéros pour simplifier les calculs, car les termes avec des zéros n'ont pas besoin d'être calculés.

Pour les matrices de très grande taille, ou pour des calculs numériques, d'autres méthodes comme la méthode du pivot de Gauss sont souvent plus efficaces.

Pour les matrices 3x3, la règle de Sarrus est généralement plus rapide et plus simple que le développement par cofacteurs, si elle est applicable.

- Méthode du Pivot de Gauss : C'est une méthode plus générale et systématique pour inverser une matrice (et aussi pour résoudre des systèmes linéaires). On la verra surtout dans les exercices, mais sachez qu'elle est très puissante !

- Polynôme Annulateur : C'est une technique un peu plus avancée. Si on trouve un polynôme \(P(X)\) tel que \(P(A) = 0\) (la matrice nulle) et que ce polynôme a un terme constant non nul, alors on peut montrer que \(A\) est inversible et même trouver une formule pour \(A^{-1}\) à partir de \(P(A) = 0\).

Exemple d'Inversion avec un Polynôme Annulateur : Supposons qu'on sache que pour une matrice \(A\), on a \(A^2 - 3A + 2I = 0\). Alors, on peut réécrire cette équation comme \(2I = 3A - A^2 = A(3I - A)\). En divisant par 2, on obtient \(I = A \left( \frac{1}{2}(3I - A) \right)\). Donc, par définition de l'inverse, on a \(A^{-1} = \frac{1}{2}(3I - A)\). C'est une manière élégante de trouver l'inverse sans calculs compliqués !

Conseil Pratique : Le déterminant est votre ami pour vérifier rapidement l'inversibilité. Le pivot de Gauss est la méthode robuste pour calculer l'inverse en pratique, et le polynôme annulateur est une astuce à connaître pour certains cas particuliers, souvent dans les exercices théoriques.

3. Puissances de Matrices : Techniques de Calcul Malin

Calculer \(A^n\), c'est multiplier \(A\) par elle-même \(n\) fois. Si \(n\) est grand, faire les multiplications directement peut être très long et fastidieux ! Heureusement, il y a des techniques plus intelligentes :

- Récurrence : Parfois, en calculant les premières puissances \(A^2, A^3, \dots\), on remarque un motif, une formule générale pour \(A^n\). On peut alors prouver cette formule par récurrence. C'est une méthode puissante si on arrive à "voir" le motif !

Conseil Pratique : N'hésitez pas à calculer \(A^2\), \(A^3\) à la main pour les petits \(n\). Souvent, la structure de la matrice \(A^n\) devient claire après quelques itérations.

Exemple simple avec récurrence : Soit \(D = \begin{pmatrix} 2 & 0 \\ 0 & 3 \end{pmatrix}\) une matrice diagonale. Calculons les premières puissances : \(D^2 = \begin{pmatrix} 4 & 0 \\ 0 & 9 \end{pmatrix}\), \(D^3 = \begin{pmatrix} 8 & 0 \\ 0 & 27 \end{pmatrix}\). On conjecture que \(D^n = \begin{pmatrix} 2^n & 0 \\ 0 & 3^n \end{pmatrix}\). On peut facilement prouver cette formule par récurrence.

- Binôme de Newton : Vous connaissez le binôme \((a+b)^n = \sum_{k=0}^n \binom{n}{k} a^{n-k} b^k\). Il existe une formule similaire pour les matrices : \((B + C)^n = \sum_{k=0}^n \binom{n}{k} B^{n-k} C^k\). Attention : Cette formule ne marche que si les matrices \(B\) et \(C\) commutent, c'est-à-dire si \(BC = CB\). C'est particulièrement utile si on peut écrire \(A = I + B\) où \(B\) est une matrice "simple" comme une matrice nilpotente (voir section suivante) ou si \(B\) commute avec \(I\) (ce qui est toujours le cas !).

Exemple avec Binôme de Newton : Soit \(A = \begin{pmatrix} 1 & 1 \\ 0 & 1 \end{pmatrix}\). On peut écrire \(A = I + B\) avec \(I = \begin{pmatrix} 1 & 0 \\ 0 & 1 \end{pmatrix}\) et \(B = \begin{pmatrix} 0 & 1 \\ 0 & 0 \end{pmatrix}\). Comme \(IB = BI = B\), on peut appliquer le binôme de Newton : $$A^n = (I+B)^n = \binom{n}{0}I^n + \binom{n}{1}I^{n-1}B + \binom{n}{2}I^{n-2}B^2 + \dots + \binom{n}{n}B^n$$ Or, on remarque que \(B^2 = \begin{pmatrix} 0 & 1 \\ 0 & 0 \end{pmatrix} \begin{pmatrix} 0 & 1 \\ 0 & 0 \end{pmatrix} = \begin{pmatrix} 0 & 0 \\ 0 & 0 \end{pmatrix} = 0\). Donc, \(B^2 = B^3 = \dots = B^n = 0\) pour \(n \geq 2\). La formule se simplifie énormément : $$A^n = I + nB = \begin{pmatrix} 1 & 0 \\ 0 & 1 \end{pmatrix} + n \begin{pmatrix} 0 & 1 \\ 0 & 0 \end{pmatrix} = \begin{pmatrix} 1 & n \\ 0 & 1 \end{pmatrix}$$ Calculer \(A^n\) devient très facile !

- Polynôme Annulateur et Division Euclidienne : Encore une technique plus avancée, mais très efficace ! Si on connaît un polynôme annulateur \(P(X)\) de \(A\) (tel que \(P(A) = 0\)), on peut utiliser la division euclidienne de \(X^n\) par \(P(X)\). Si on écrit \(X^n = Q(X)P(X) + R(X)\) avec le degré de \(R(X)\) plus petit que le degré de \(P(X)\), alors on a \(A^n = R(A)\). Ça permet d'exprimer \(A^n\) comme une combinaison linéaire de puissances inférieures de \(A\). C'est très utile quand on a des polynômes annulateurs simples (comme \(X^2 - 3X + 2\) par exemple).

Conseil Pratique : Pour les puissances de matrices, commencez toujours par regarder si vous pouvez utiliser la récurrence ou le binôme de Newton. Le polynôme annulateur est une technique plus sophistiquée, mais très puissante pour les cas plus complexes.

4. Matrices Spéciales : Nilpotentes, Stochastiques, et de Rotation

Il existe des familles de matrices qui ont des propriétés particulières et qui sont très utiles dans différents contextes :

- Matrices Nilpotentes : Une matrice \(A\) est dite nilpotente s'il existe un entier \(p \geq 1\) (appelé indice de nilpotence) tel que \(A^p = 0\). Ces matrices ont des valeurs propres toutes nulles (leur spectre propre est réduit à \(\{0\}\)). Elles sont très pratiques car elles simplifient le calcul de \((I - A)^{-1}\) en utilisant la série géométrique matricielle (qui devient une somme finie car les puissances de \(A\) finissent par s'annuler).

Exemple : La matrice \(B = \begin{pmatrix} 0 & 1 \\ 0 & 0 \end{pmatrix}\) est nilpotente d'indice 2 car \(B^2 = \begin{pmatrix} 0 & 0 \\ 0 & 0 \end{pmatrix} = 0\). Donc, pour cette matrice, \((I - B)^{-1} = I + B = \begin{pmatrix} 1 & 1 \\ 0 & 1 \end{pmatrix}\). Beaucoup plus simple que d'inverser directement \((I-B)\) !

- Matrices Stochastiques : Ce sont des matrices carrées dont tous les coefficients sont positifs ou nuls et dont la somme des coefficients de chaque ligne est égale à 1. Elles sont utilisées pour modéliser des systèmes probabilistes où l'état total du système est conservé (par exemple, des chaînes de Markov). Les matrices bistochastiques ont en plus la propriété que la somme des coefficients de chaque colonne est aussi égale à 1. Elles sont liées aux permutations et au théorème de Birkhoff-Von Neumann (mais ça, c'est pour plus tard !).

Exemple : \(S = \begin{pmatrix} 0.5 & 0.5 \\ 0.3 & 0.7 \end{pmatrix}\) est une matrice stochastique car tous les coefficients sont positifs et \(0.5 + 0.5 = 1\) et \(0.3 + 0.7 = 1\).

- Matrices de Rotation 2D : Elles servent à représenter des rotations d'angle \(\theta\) autour de l'origine dans le plan. Elles ont une forme très précise :

$$ R(\theta) = \begin{pmatrix} \cos(\theta) & -\sin(\theta) \\ \sin(\theta) & \cos(\theta) \end{pmatrix} $$

Leur déterminant est toujours égal à 1, ce qui garantit que les rotations conservent les aires et les orientations. Si vous multipliez un vecteur par \(R(\theta)\), vous faites tourner ce vecteur d'un angle \(\theta\) dans le sens trigonométrique.

Exemple : Pour une rotation de 90 degrés (\(\theta = \pi/2\)), on a \(\cos(\pi/2) = 0\) et \(\sin(\pi/2) = 1\). Donc, la matrice de rotation est \(R(\pi/2) = \begin{pmatrix} 0 & -1 \\ 1 & 0 \end{pmatrix}\). Si on applique cette matrice au vecteur \(\begin{pmatrix} 1 \\ 0 \end{pmatrix}\) (le vecteur unitaire horizontal), on obtient \(R(\pi/2) \begin{pmatrix} 1 \\ 0 \end{pmatrix} = \begin{pmatrix} 0 & -1 \\ 1 & 0 \end{pmatrix} \begin{pmatrix} 1 \\ 0 \end{pmatrix} = \begin{pmatrix} 0 \\ 1 \end{pmatrix}\) (le vecteur unitaire vertical), ce qui correspond bien à une rotation de 90 degrés !

Conseil Pratique : Retenez bien ces familles de matrices spéciales. Elles reviennent souvent dans les exercices et les problèmes, et comprendre leurs propriétés vous fera gagner beaucoup de temps !

C'est noté ? 💪 Maintenant, place aux exercices ! Entraînez-vous bien, c'est en pratiquant qu'on devient fort en matrices ! Bonne chance !

Exercice 1 - Matrices Commutantes

Soient \(a\) et \(b\) deux nombres réels non nuls. On considère la matrice \(A=\left( \begin{array}{cc} a & b\\ 0 &a \end{array} \right).\) Trouver toutes les matrices \(B\in\mathcal M_2(\mathbb R)\) qui commutent avec \(A\), c'est-à-dire telles que \(AB=BA\). Décrire la forme générale de ces matrices \(B\).

Exercice 2 - Matrices Annulateurs et Inversibilité

On considère les matrices \(A=\left(\begin{array}{ccc} 1&0&0\\ 0&1&1\\ 3&1&1\end{array}\right)\), \(B=\left(\begin{array}{ccc} 1&1&1\\ 0&1&0\\ 1&0&0\end{array}\right)\) et \(C=\left(\begin{array}{ccc} 1&1&1\\ 1&2&1\\ 0&-1&-1\end{array}\right)\).

- Calculer les produits matriciels \(AB\) et \(AC\). Que remarquez-vous ?

- La matrice \(A\) est-elle inversible ? Justifier votre réponse.

- Trouver toutes les matrices \(F\in\mathcal M_3(\mathbb R)\) telles que \(AF=0\), où \(0\) désigne la matrice nulle 3x3.

Exercice 3 - Produit Matriciel Non Commutatif

Trouver deux matrices carrées \(A\) et \(B\) d'ordre 2 (\(\mathcal M_2({\mathbb R})\)) telles que leur produit \(AB\) soit la matrice nulle, mais que le produit \(BA\) ne soit pas la matrice nulle. Justifier votre choix.

Exercice 4 - Puissance $n$-ième d'une Matrice par Récurrence

On considère les matrices suivantes : $$A=\left(\begin{array}{cc} 1&-1\\ -1&1\\ \end{array}\right),\ B=\left(\begin{array}{cc} 1&1\\ 0&2\\ \end{array}\right).$$

- Calculer \(A^2\) et \(A^3\). Conjecturer une formule pour \(A^n\) pour tout entier \(n\geq 1\), puis démontrer cette formule par récurrence.

- Calculer \(B^2\) et \(B^3\). Conjecturer une formule pour \(B^n\) pour tout entier \(n\geq 1\), puis démontrer cette formule par récurrence.

Exercice 5 - Puissance $n$-ième et Binôme de Newton

Soit $$A=\left( \begin{array}{ccc} 1&1&0\\ 0&1&1\\ 0&0&1 \end{array}\right),\quad I=\left( \begin{array}{ccc} 1&0&0\\ 0&1&0\\ 0&0&1 \end{array}\right)\textrm{ et } B=A-I.$$

- Calculer les matrices \(B\), \(B^2\), \(B^3\). Que remarquez-vous pour les puissances de \(B\) ?

- Exprimer \(A\) en fonction de \(I\) et \(B\). Justifier pourquoi on peut utiliser la formule du binôme de Newton pour calculer \(A^n\).

- Calculer \(A^n\) pour tout entier naturel \(n\) en utilisant la formule du binôme de Newton.

Exercice 6 - Puissance $n$-ième et Division Euclidienne de Polynômes

- Pour un entier \(n\geq 2\), déterminer le reste de la division euclidienne du polynôme \(X^n\) par le polynôme \(P(X) = X^2-3X+2\).

- Soit \(A=\begin{pmatrix} 0&1&-1\\ -1&2&-1\\ 1&-1&2 \end{pmatrix}\). Calculer \(A^2-3A+2I_3\). En utilisant le résultat de la question 1, exprimer \(A^n\) en fonction de \(A\) et de la matrice identité \(I_3\) pour \(n\geq 2\).

Exercice 7 - Système 3x3, Inversibilité et Pivot de Gauss

On considère le système d'équations linéaires suivant : $$ \begin{cases} x + 2y - z = 2 \\ 2x - y + 3z = -5 \\ -x + 3y + 2z = 7 \end{cases} $$

- Écrire ce système d'équations sous la forme matricielle \(AX = B\), où \(A\) est une matrice carrée d'ordre 3, \(X = \begin{pmatrix} x \\ y \\ z \end{pmatrix}\) est le vecteur des inconnues, et \(B\) est un vecteur colonne. Préciser les matrices \(A\) et \(B\).

- Calculer le déterminant de la matrice \(A\). La matrice \(A\) est-elle inversible ? Justifier votre réponse.

- Calculer la matrice inverse \(A^{-1}\) en utilisant la méthode du pivot de Gauss. Détaillez les étapes du pivot de Gauss.

- Utiliser la matrice inverse \(A^{-1}\) pour résoudre le système d'équations \(AX = B\). Donner les valeurs de \(x\), \(y\) et \(z\).

- Vérifier votre solution en remplaçant les valeurs de \(x\), \(y\) et \(z\) trouvées dans le système d'équations initial.

Exercice 8 - Inverser une Matrice à Partir d'une Égalité

- Soit \( A=\left( \begin{array}{ccc} -1&1&1\\ 1&-1&1\\ 1&1&-1 \end{array}\right)\). Montrer que \(A^2=2I_3-A\). En déduire que \(A\) est inversible et exprimer \(A^{-1}\) en fonction de \(A\) et \(I_3\).

- Soit \( A=\begin{pmatrix} 1 & 0 & 2 \cr 0 & -1 & 1 \cr 1 & -2 & 0 \cr \end{pmatrix} .\) Calculer \( A^3-5A .\) Expliquer pourquoi, à partir de ce calcul, on ne peut pas déduire directement que \(A\) est inversible et exprimer \( A^{-1} \) en fonction de \(A^2\), \(A\) et \(I_3\) comme dans les questions précédentes.**

- Soit \(A=\begin{pmatrix} 0&1&-1\\ -1&2&-1\\ 1&-1&2 \end{pmatrix}\). Calculer \(A^2-3A+3I_3\). En déduire que \(A\) est inversible, et exprimer \(A^{-1}\) en fonction de \(A\) et \(I_3\).

Exercice 9 - Calcul d'Inverse par Pivot de Gauss

Déterminer si les matrices suivantes sont inversibles et, si oui, calculer leur inverse en utilisant la méthode du pivot de Gauss. $$A=\left( \begin{array}{rcl} 1&1&2\\ 1&2&1\\ 2&1&1 \end{array} \right),\quad B=\left( \begin{array}{rcl} 0&1&2\\ 1&1&2\\ 0&2&3 \end{array} \right),\quad C=\left( \begin{array}{rcl} 1&4&7\\ 2&5&8\\ 3&6&9 \end{array} \right),\quad I=\left( \begin{array}{rcl} i&-1&2i\\ 2&0&2\\ -1&0&1 \end{array} \right). \text{ (matrice à coefficients dans $\mathbb{C}$)}$$

Exercice 10 - Inversibilité de \(I_n - A\) pour Matrice Nilpotente \(A\)

Soit \(A\in\mathcal M_n(\mathbb R)\) une matrice nilpotente, c'est-à-dire qu'il existe un entier \(p\geq 1\) tel que \(A^p=0\). Démontrer que la matrice \(I_n-A\) est inversible, et déterminer une expression pour son inverse en fonction de \(A\) et de puissances de \(A\).

Exercice 11 - Matrices Stochastiques et Stabilité par Produit

Pour \(n\geq 1\), on note \(\mathcal D\) l'ensemble des matrices \(A\) de \(\mathcal M_n(\mathbb R)\) telles que \(a_{i,j}\geq 0\) pour tout \(i,j\) et \(\sum_{j=1}^n a_{i,j}=1\) pour tout \(i=1,\dots,n\).

- Démontrer que \(\mathcal D\) est stable par produit.

- Déterminer les matrices \(A\) de \(\mathcal D\) qui sont inversibles et telles que \(A^{-1}\in\mathcal D\).

Exercice 12 - Matrices de Rotation 2D

- Démontrer que la forme générale d'une matrice de rotation 2D d'angle \(\theta\) est donnée par :

$$ R(\theta) = \begin{pmatrix} \cos(\theta) & -\sin(\theta) \\ \sin(\theta) & \cos(\theta) \end{pmatrix} $$

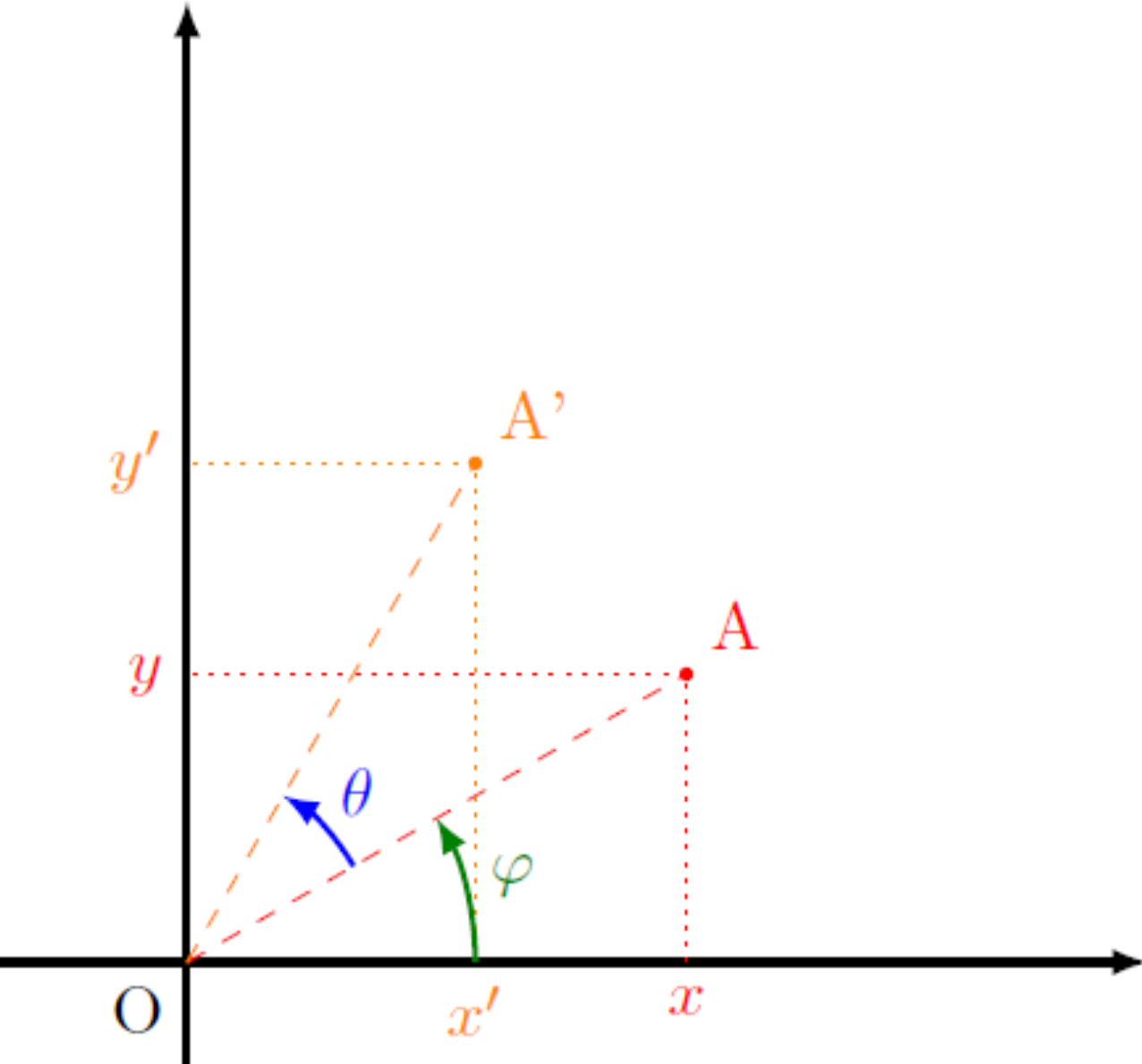

Question 1.1 : Coordonnées Polaires

Rappelez-vous, comment peut-on aussi décrire la position de ce point \(A\) en utilisant des coordonnées polaires \((r, \phi)\) ? Quelles sont les relations entre les coordonnées cartésiennes \((x, y)\) et les coordonnées polaires \((r, \phi)\) ? Exprimez \(x\) et \(y\) en fonction de \(r\) et \(\phi\).

Indice : Pensez à la trigonométrie dans un triangle rectangle formé par le point \(A\), sa projection sur l'axe des x, et l'origine.

Question 2.1 : Rotation et Coordonnées Polaires

Si on effectue une rotation d'angle \(\theta\) autour de l'origine sur le point \(A\), obtenant un nouveau point \(A'\), comment la rotation affecte-t-elle les coordonnées polaires de \(A\) ? Si les coordonnées polaires de \(A\) sont \((r, \phi)\), quelles seront les coordonnées polaires \((r', \phi')\) du point \(A'\) après une rotation d'angle \(\theta\) ?

Indice : Une rotation autour de l'origine modifie-t-elle la distance à l'origine ? Qu'advient-il de l'angle polaire ?

Question 3.1 : Formules Trigonométriques

Pour relier \(x'\) et \(y'\) aux coordonnées initiales \((x, y)\), nous allons utiliser les formules d'addition d'angles en trigonométrie. Rappelez-vous et écrivez les formules pour \(\cos(\phi+\theta)\) et \(\sin(\phi+\theta)\) en fonction de \(\cos(\phi)\), \(\cos(\theta)\), \(\sin(\phi)\) et \(\sin(\theta)\).

Indice : Ces formules sont fondamentales en trigonométrie et expriment le cosinus et le sinus d'une somme d'angles.

Question 4.1 : Substitution et Simplification

Substituez les expressions de \(\cos(\phi+\theta)\) et \(\sin(\phi+\theta)\) dans les équations pour \(x'\) et \(y'\) que nous avons établies précédemment. Puis, utilisez les relations \(x = r \cos(\phi)\) et \(y = r \sin(\phi)\) pour exprimer \(x'\) et \(y'\) en fonction de \(x\), \(y\), \(\cos(\theta)\) et \(\sin(\theta)\).

Indice : Le but est d'éliminer les coordonnées polaires \(r\) et \(\phi\) au profit des coordonnées cartésiennes initiales \(x\) et \(y\).

Question 5.1 : Formulation Matricielle

Réécrivez le système d'équations que vous venez d'obtenir sous forme matricielle. Vous devriez obtenir une expression de la forme : $$ \begin{pmatrix} x' \\ y' \end{pmatrix} = R(\theta) \begin{pmatrix} x \\ y \end{pmatrix} $$ où \(R(\theta)\) est une matrice 2x2. Identifiez les éléments de la matrice \(R(\theta)\) en comparant avec les équations pour \(x'\) et \(y'\).

Indice : Rappelez-vous comment la multiplication matricielle est définie pour retrouver les équations que vous avez établies.

- Application : Utiliser la matrice de rotation \(R(45^\circ)\) pour trouver les coordonnées du point \(P'\) obtenu en rotant le point \(P = (1, 0)\) de 45° autour de l'origine. Illustrer graphiquement.